Selles artiklis arutame, kuidas jaotada ERINEVAD mälu kaudu ' pytorch_cuda_alloc_conf ” meetod.

Mis on PyTorchis meetod 'pytorch_cuda_alloc_conf'?

Põhimõtteliselt on ' pytorch_cuda_alloc_conf ” on PyTorchi raamistikus olev keskkonnamuutuja. See muutuja võimaldab olemasolevaid töötlemisressursse tõhusalt hallata, mis tähendab, et mudelid töötavad ja annavad tulemusi võimalikult lühikese aja jooksul. Kui seda ei tehta korralikult, siis ' ERINEVAD ' arvutusplatvorm kuvab ' mälu täis ” viga ja mõjutavad käitusaega. Mudelid, mida tuleb koolitada suurte andmemahtude jaoks või millel on suured ' partiide suurused ” võib tekitada käitusvigu, kuna vaikesätetest ei pruugi nende jaoks piisata.

' pytorch_cuda_alloc_conf 'muutuja kasutab järgmist ' valikuid ” ressursside eraldamiseks:

- emakeelena : see suvand kasutab PyTorchis juba saadaolevaid sätteid, et eraldada pooleliolevale mudelile mälu.

- max_split_size_mb : See tagab, et ühtegi määratud suurusest suuremat koodiplokki osadeks ei jagata. See on võimas vahend, et vältida ' killustatus ”. Kasutame seda valikut selles artiklis tutvustamiseks.

- roundup_power2_divisions : see valik ümardab jaotuse suuruse ülespoole lähima ' võimsus 2 ” jaotus megabaitides (MB).

- roundup_bypass_threshold_mb: See võib ümardada jaotuse suuruse ülespoole mis tahes päringu puhul, mis ületab määratud läve.

- prügi_kogumise_lävi : see takistab latentsust, kasutades reaalajas GPU-st saadaolevat mälu, et tagada, et kogu tagasinõudmise protokolli ei käivitata.

Kuidas eraldada mälu, kasutades meetodit 'pytorch_cuda_alloc_conf'?

Iga suure andmestikuga mudel nõuab täiendavat mälueraldust, mis on suurem kui vaikimisi määratud. Kohandatud jaotus tuleb täpsustada, võttes arvesse mudeli nõudeid ja saadaolevaid riistvararessursse.

Järgige alltoodud samme, et kasutada ' pytorch_cuda_alloc_conf ” meetod Google Colab IDE-s, et eraldada keerukale masinõppemudelile rohkem mälu:

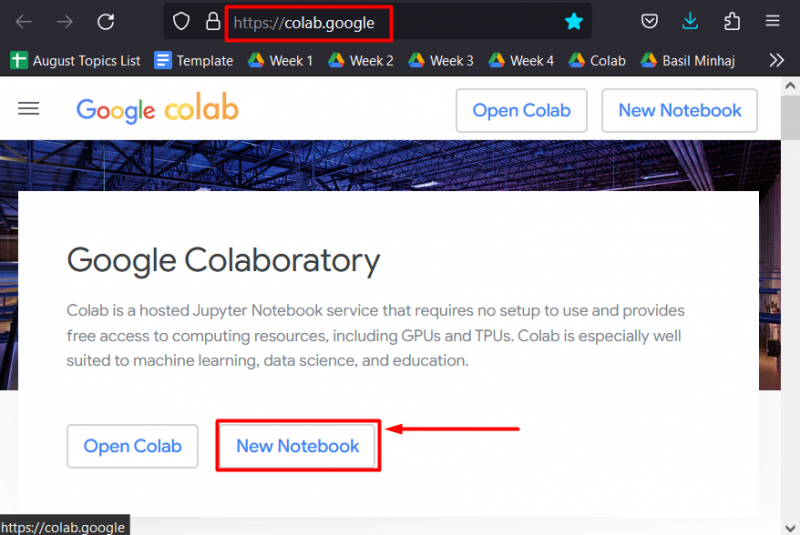

1. toiming: avage Google Colab

Otsige Google'ist Koostööaldis brauseris ja looge ' Uus märkmik ” töö alustamiseks:

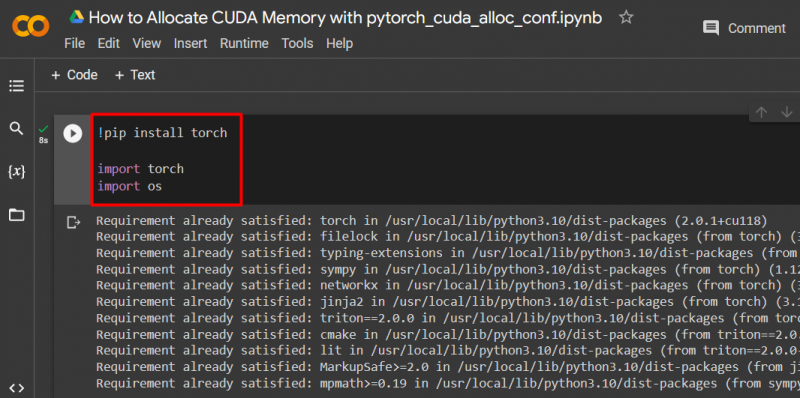

2. samm: seadistage kohandatud PyTorchi mudel

Seadistage PyTorchi mudel, kasutades ' !pip ' installipakett ' installimiseks tõrvik ' raamatukogu ja ' importida ' käsk importida ' tõrvik ” ja „ sina ” raamatukogud projekti:

import tõrvik

importida meid

Selle projekti jaoks on vaja järgmisi teeke:

- Tõrvik - See on põhiline raamatukogu, millel PyTorch põhineb.

- SINA – ' operatsioonisüsteem ' teeki kasutatakse selliste keskkonnamuutujatega seotud ülesannete käsitlemiseks nagu ' pytorch_cuda_alloc_conf ”, samuti süsteemikataloog ja failiõigused:

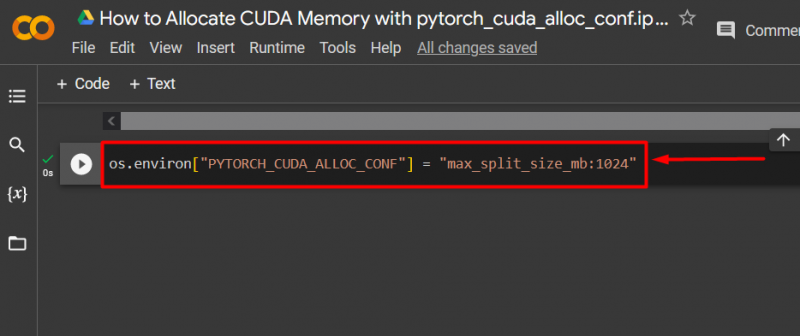

3. samm: eraldage CUDA mälu

Kasuta ' pytorch_cuda_alloc_conf ' meetod maksimaalse jaotuse suuruse määramiseks kasutades ' max_split_size_mb ”:

4. samm: jätkake oma PyTorchi projektiga

Pärast seda, kui olete täpsustanud ' ERINEVAD ruumi jaotus koos ' max_split_size_mb ', jätkake PyTorchi projektiga töötamist nagu tavaliselt, kartmata ' mälu täis ” viga.

Märge : meie Google Colabi märkmikule pääsete juurde siit link .

Pro-Tip

Nagu eelnevalt mainitud, ' pytorch_cuda_alloc_conf ” meetod võib kasutada mis tahes ülaltoodud valikuid. Kasutage neid vastavalt oma süvaõppeprojektide spetsiifilistele nõuetele.

Edu! Näitasime just, kuidas kasutada pytorch_cuda_alloc_conf ' meetod, et määrata ' max_split_size_mb ” PyTorchi projekti jaoks.

Järeldus

Kasuta ' pytorch_cuda_alloc_conf ” meetod CUDA-mälu eraldamiseks, kasutades mõnda selle saadaolevatest valikutest vastavalt mudeli nõuetele. Kõik need valikud on mõeldud PyTorchi projektide konkreetse töötlemisprobleemi leevendamiseks parema käitusaja ja sujuvamate toimingute tagamiseks. Selles artiklis oleme tutvustanud süntaksit ' max_split_size_mb ” suvand, et määrata jaotuse maksimaalne suurus.