Selles ajaveebis käsitleme alltoodud sisu:

- Kuidas kohandada teksti genereerimist, laadides mudeli trafode torujuhtme funktsiooniga?

- Kuidas kasutada PyTorchis teksti genereerimiseks transformaatoripõhist mudelit?

- Kuidas kasutada TensorFlow's teksti genereerimiseks trafopõhist mudelit?

Kuidas kohandada teksti genereerimist, laadides mudelile trafode 'pipeline' funktsiooni?

' torujuhe ” funktsiooni kasutatakse eelkoolitatud AI mudeli automaatseks allalaadimiseks vastavalt kasutaja nõudmistele. Selle konkreetse funktsiooni kasutamiseks peavad kasutajad installima ' trafod ” paketid. See pakett annab juurdepääsu moodsatele transformeripõhistele mudelitele, mis suudavad läbi viia sentimentide analüüsi ja paljusid muid Loomuliku keele töötlemine (NLP) ülesandeid.

Ülalkirjeldatud stsenaariumi praktilise demonstratsiooni vaatamiseks liikuge alltoodud sammude juurde!

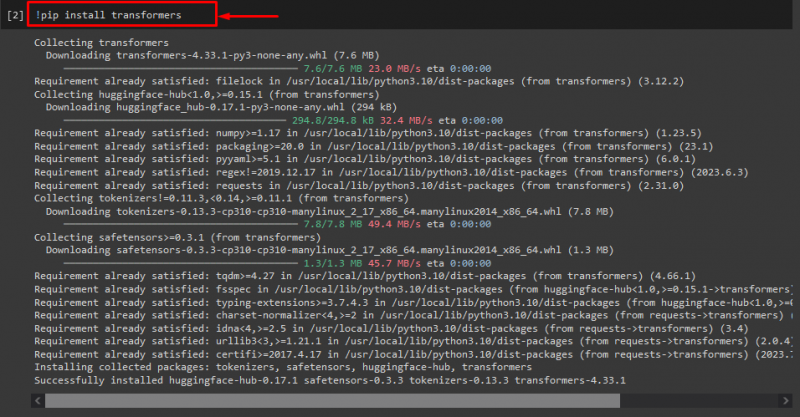

1. samm: installige 'trafode' paketid

Esialgu käivitage '! pip” käsk trafopakettide installimiseks:

! pip install trafod

Nagu näete, on määratud pakett edukalt installitud:

2. samm: importige trafol põhinev mudel

Seejärel importige vajalik trafopõhine mudel. Selleks importige esmalt torujuhe funktsioon '' trafod ”. Järgmisena kasutage imporditud funktsiooni ja edastage ' teksti genereerimine ' selle argumendiks koos vajaliku mudeli nimega ' gpt2 ”. Järgmisena edastage need ' genereerida ” muutuja:

alates trafod importida torujuhe

genereerida = torujuhe ( 'teksti genereerimine' , mudel = 'gpt2' )

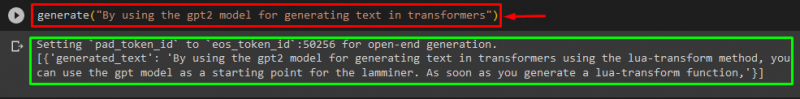

3. samm: looge kohandatud tekst

Nüüd edastage soovitud tekst argumendina ' genereerida ”. Nagu allpool näidatud:

genereerida ( 'Kasutades transformaatorites teksti genereerimiseks mudelit gpt2' )Vastavalt esitatud väljundile on allalaaditud eelkoolitatud ' gpt3 ” mudeli teksti genereerimine õnnestus:

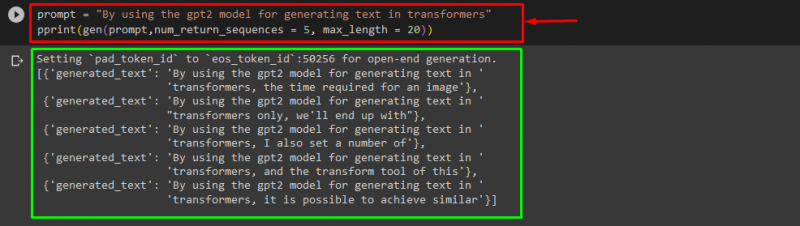

Võite kasutada ka muid argumente, näiteks:

viip = 'Kasutades transformaatorites teksti genereerimiseks mudelit gpt2'printida ( geen ( viip , jadade_arv = 5 , max_pikkus = kakskümmend ) )

Siin:

- “ viip ” kasutatakse argumendina, mis hoiab sisendit.

- “ arv_tagasi_jada ” argumenti kasutatakse esitatud teksti jadade arvu genereerimiseks.

- “ max_pikkus ” argumenti kasutatakse genereeritud teksti pikkuse määramiseks. Meie puhul piirdub see ' 30 ” märgid (sõnad või kirjavahemärgid):

Märge: Kohandatud tekst on jätk määratud viipale, mis põhineb mudeli koolitusandmetel.

Kuidas kasutada PyTorchis teksti genereerimiseks transformaatoripõhist mudelit?

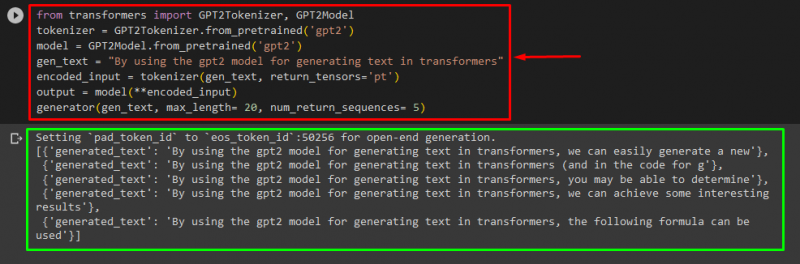

Kasutajad saavad teksti kohandada ka jaotises ' PyTorch 'mis on' Tõrvik ” põhinev masinõppe raamistik. Seda kasutatakse erinevate rakenduste jaoks, nagu NLP ja Computer Vision. Trafopõhise mudeli kasutamiseks PyTorchis teksti kohandamiseks importige esmalt GPT2Tokenisaator ” ja „ GPT2 mudel ' funktsioonid jaotisest ' trafod ”:

alates trafod importida GPT2Tokenisaator , GPT2 mudelSeejärel kasutage ' GPT2Tokenisaator ' tokenisaator vastavalt meie soovitud eelkoolitatud mudelile nimega ' gpt2 ”:

tokenisaator = GPT2Tokenisaator. alates_ettetreenitud ( 'gpt2' )Seejärel raskuste leidmine eelnevalt koolitatud mudelist:

mudel = GPT2 mudel. alates_ettetreenitud ( 'gpt2' )Järgmisena deklareerige ' gen_text ” muutuja, mis sisaldab teksti, mida tahame kohandada:

gen_text = 'Kasutades transformaatorites teksti genereerimiseks mudelit gpt2'Nüüd läbige ' gen_text ” ja „ return_tensors='pt' ' argumendina, mis genereerib teksti PyTorchis ja salvestab loodud väärtuse ' kodeeritud_sisend ” muutuja:

kodeeritud_sisend = tokenisaator ( gen_text , return_tensors = 'pt' )Viimasena jätke ' kodeeritud_sisend ' muutuja, mis hoiab kohandatud teksti ' mudel ' parameetrina ja saada saadud väljund, kasutades ' max_pikkus ' argument, mis on seatud väärtusele ' kakskümmend ', mis näitab, et loodud tekst piirdub etteantud märkidega, ' arv_tagasi_jadasid ', mis on seatud väärtusele ' 5 ', mis näitab, et loodud tekst tugineb viiele tekstijadale:

väljund = mudel ( **kodeeritud_sisend )generaator ( gen_text , max_pikkus = kakskümmend , arv_tagasi_jadasid = 5 )

Väljund

Kuidas kasutada TensorFlow's teksti genereerimiseks trafopõhist mudelit?

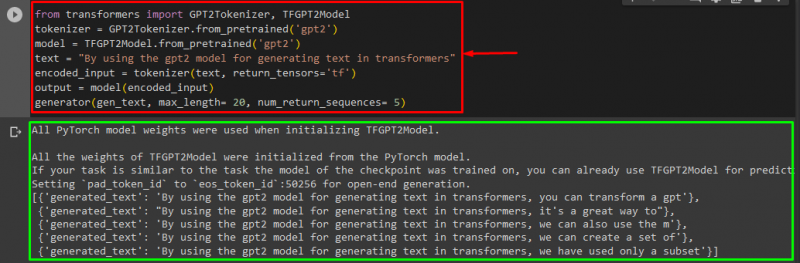

Transformersis teksti genereerimiseks kasutage TensorFlow ” kasutatakse ka masinõppe raamistikke. Selleks importige esmalt vajalikud funktsioonid, näiteks GPT2Tokenisaator ” ja „ TFGPT2 mudel ' alates ' trafod ”. Ülejäänud kood on sama, mis ülal, lihtsalt kasutame ' TFGPT2 mudel funktsioon '' asemel GPT2 mudel ” funktsioon. Järgnevalt:

alates trafod importida GPT2Tokenisaator , TFGPT2 mudeltokenisaator = GPT2Tokenisaator. alates_ettetreenitud ( 'gpt2' )

mudel = TFGPT2 mudel. alates_ettetreenitud ( 'gpt2' )

tekst = 'Kasutades transformaatorites teksti genereerimiseks mudelit gpt2'

kodeeritud_sisend = tokenisaator ( tekst , return_tensors = 'tf' )

väljund = mudel ( kodeeritud_sisend )

generaator ( gen_text , max_pikkus = kakskümmend , jadade_arv = 5 )

Nagu näete, on kohandatud tekst edukalt loodud:

See on kõik! Oleme käsitlenud teksti genereerimise kohandamist rakenduses Transformers.

Järeldus

Teksti genereerimise kohandamiseks rakenduses Transformers on erinevaid viise, näiteks laadige mudel konveierifunktsiooniga, kasutades trafopõhist mudelit jaotises ' PyTorch ” ja „ TensorFlow ”, mis põhinevad masinõppe raamistikel. Selles juhendis oleme pakkunud lühikest teavet ja praktilise tutvustuse teksti genereerimise kohandamise kohta rakenduses Transformers.