LangChain on loomuliku keele töötlemise või NLP-domeeni rakendusega raamistik, mis võimaldab luua mudeleid inimlikes keeltes. Inimesed saavad neid mudeleid kasutada, et saada mudelilt vastuseid või vestelda nagu iga teine inimene. LangChaini kasutatakse ahelate loomiseks, salvestades vestluse iga lause ja kasutades seda kontekstina edasi.

See postitus illustreerib LLM-i ja LLMChaini loomise protsessi LangChainis.

Kuidas luua LLM-i ja LLMChaini LangChainis?

LLM-i ja LLMChaini loomiseks LangChainis tehke lihtsalt loetletud sammud:

1. samm: installige moodulid

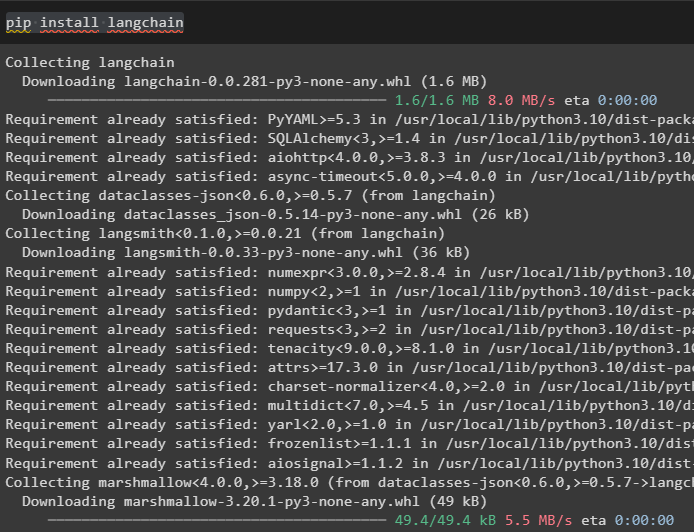

Esiteks installige LangChaini moodul, et kasutada selle teeke LLM-ide ja LLMChaini loomiseks:

pip install langchain

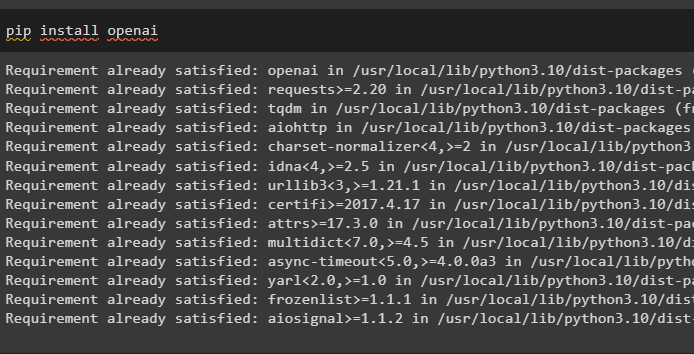

Veel üks LLM-ide ehitamiseks vajalik moodul on OpenAI ja selle saab installida pip-käsuga:

pip install openai

2. samm: seadistage keskkond

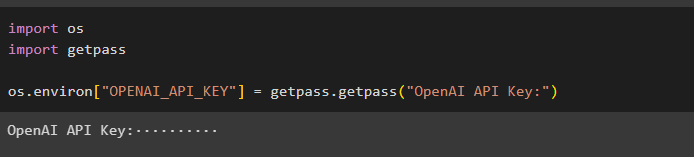

Seadistage keskkond, kasutades selle keskkonnast pärit OpenAI API võtit:

importida meidimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API võti:')

Näide 1: Looge LLM-id LangChaini abil

Esimene näide on suurte keelemudelite loomine LangChaini abil, importides OpenAI ja ChatOpenAI teegid ning kasutades funktsiooni llm().

1. samm: LLM-i vestlusmudeli kasutamine

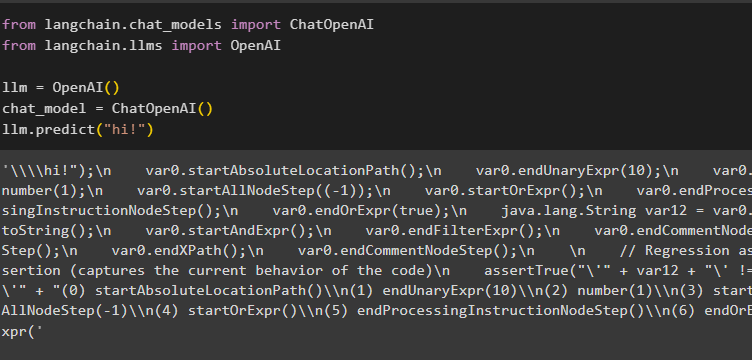

Importige OpenAI ja ChatOpenAI moodulid, et luua lihtne LLM, kasutades OpenAI keskkonda LangChainist:

langchain.chat_models impordib ChatOpenAI-dlangchain.llms-ist importige OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('tere!')

Mudel vastas 'tere' vastusega, nagu on näidatud alloleval ekraanipildil:

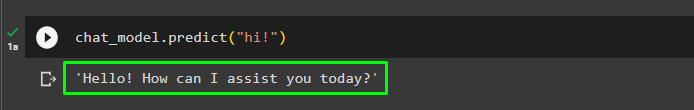

Chat_model funktsiooni ennusta() kasutatakse vastuse või vastuse saamiseks mudelist:

chat_model.predict('tere!')Väljund näitab, et mudel on päringuid esitava kasutaja käsutuses:

2. samm: tekstipäringu kasutamine

Samuti saab kasutaja mudelist vastuseid anda tekstimuutujas täislause:

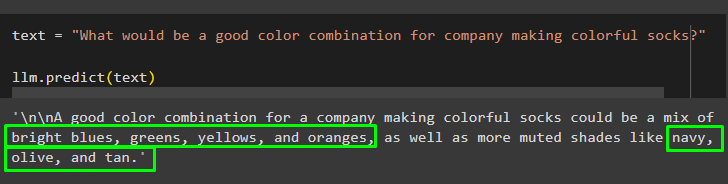

text = 'Mis oleks hea ettevõtte nimi ettevõttele, mis toodab värvilisi sokke?'llm.predict(text)

Mudelil on värviliste sokkide jaoks kuvatud mitu värvikombinatsiooni:

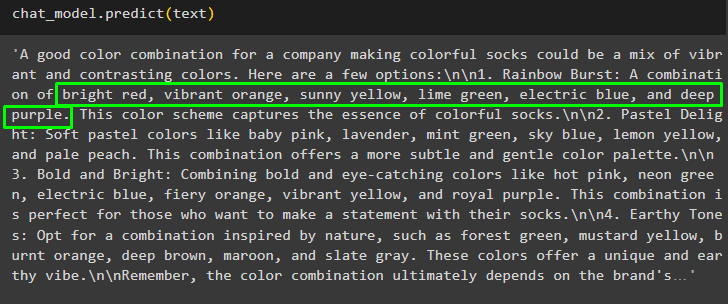

Hankige mudelilt üksikasjalik vastus, kasutades funktsiooni ennusta () koos sokkide värvikombinatsioonidega:

chat_model.predict(text)

3. samm: teksti kasutamine sisuga

Kasutaja saab vastuse koos väikese selgitusega vastuse kohta:

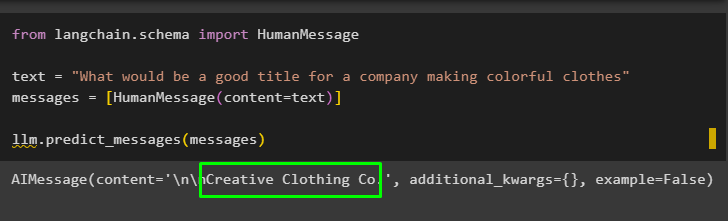

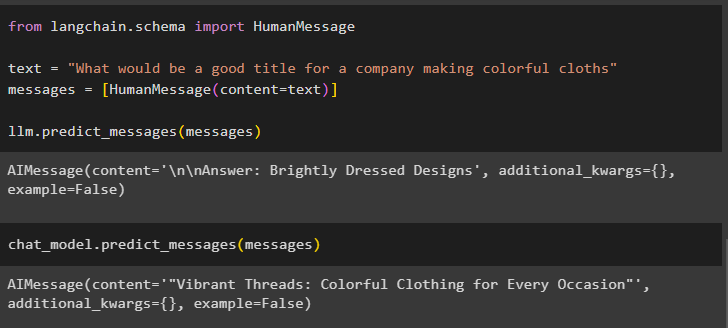

langchain.schema impordist HumanMessagetext = 'Mis oleks hea pealkiri värvilisi riideid tootvale ettevõttele'

sõnumid = [HumanMessage(content=text)]

llm.predict_messages(messages)

Mudel on loonud ettevõttele pealkirja 'Creative Clothing Co':

Ennustage sõnum, et saada vastus ka ettevõtte nimetuse kohta koos selgitusega:

chat_model.predict_messages(messages)

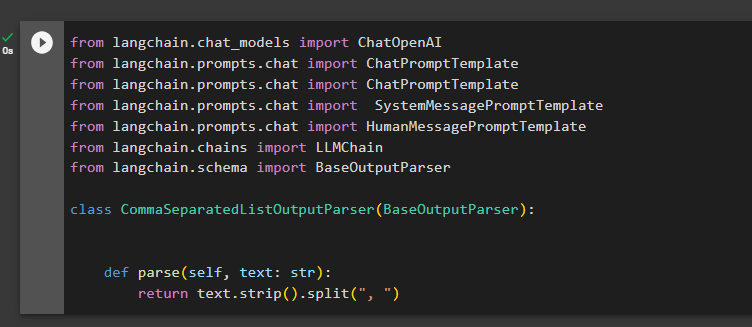

Näide 2: LLMChaini loomine LangChaini abil

Meie juhendi teine näide loob LLMChaini, et saada mudel inimsuhtluse vormingus, et ühendada kõik eelmise näite sammud:

langchain.chat_models impordib ChatOpenAI-dimportida saidist langchain.prompts.chat ChatPromptTemplate

importida saidist langchain.prompts.chat ChatPromptTemplate

langchain.prompts.chat importimisest SystemMessagePromptTemplat saidilt langchain.prompts.chat import HumanMessagePromptTemplate

saidilt langchain.chains impordi LLMChain

langchain.schema impordist BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse (ise, tekst: str):

tagasta tekst.riba().split(', ')

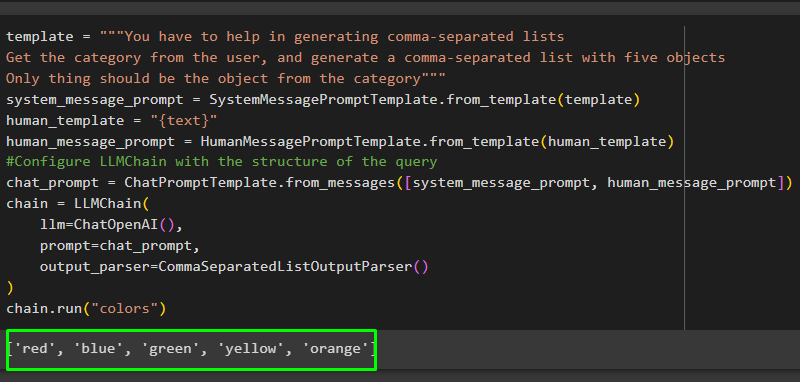

Koostage vestlusmudeli mall, selgitades üksikasjalikult selle toimimist, ja seejärel koostage funktsioon LLMChain(), mis sisaldab LLM-i, väljundparserit ja chat_prompt teeke:

template = '''Peate aitama komadega eraldatud loendite loomiselHankige kasutajalt kategooria ja looge viie objektiga komadega eraldatud loend

Ainus asi peaks olema objekt kategooriast'''

system_message_prompt = SystemMessagePromptMall.from_template(mall)

human_template = '{tekst}'

human_message_prompt = HumanMessagePromptMall.from_template(inimese_mall)

#Seadistage LLMChain päringu struktuuriga

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

kett = LLMchain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('värvid')

Mudel on andnud vastuse koos värvide loendiga, kuna kategooria peaks sisaldama ainult 5 viipas antud objekti:

See kõik puudutab LLM-i ja LLMChaini loomist LangChainis.

Järeldus

LLM-i ja LLMChaini loomiseks LangChaini abil installige lihtsalt moodulid LangChain ja OpenAI, et seadistada keskkond, kasutades selle API-võtit. Pärast seda looge LLM-mudel, kasutades chat_model'i, pärast seda, kui olete loonud ühe päringu viipamalli täieliku vestluse jaoks. LLMChaini kasutatakse kõigi vestluse vaatluste ahelate loomiseks ja nende kasutamiseks suhtluse kontekstina. See postitus illustreerib LLM-i ja LLMChaini loomise protsessi LangChaini raamistiku abil.