See artikkel sisaldab samm-sammult juhendit Tokenisaatorite kasutamise kohta Hugging Face Transformersis.

Mis on Tokenisaator?

Tokenizer on NLP oluline kontseptsioon ja selle peamine eesmärk on tõlkida toortekst numbriteks. Selleks on olemas erinevad tehnikad ja metoodikad. Siiski väärib märkimist, et igal tehnikal on kindel eesmärk.

Kuidas kasutada tokenisereid kallistavates näotransformerites?

Kuidas kasutada tokenisereid kallistavates näotransformerites?

Tokenisaatori teek tuleb enne selle kasutamist ja funktsioonide importimist installida. Pärast seda treenige mudelit AutoTokeniseri abil ja seejärel sisestage sisend tokeniseerimiseks.

Hugging Face tutvustab kolme peamist märgistamise kategooriat, mis on toodud allpool:

- Sõnapõhine märgistaja

- Tähemärgipõhine Tokenisaator

- Alamsõnapõhine märgistaja

Siin on samm-sammuline juhend tokenisaatorite kasutamiseks Transformersis:

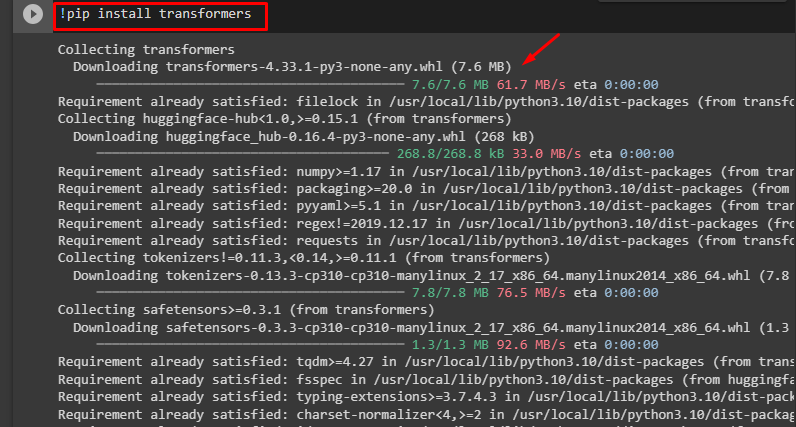

1. samm: installige transformerid

Trafode installimiseks kasutage järgmises käsus käsku pip:

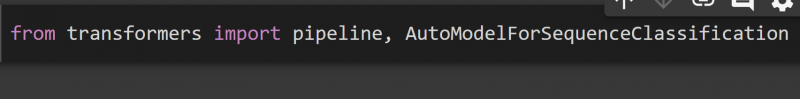

2. samm: importige klassid

Trafodest, import torujuhe ja AutoModelForSequenceClassification klassifitseerimise teostamiseks raamatukogu:

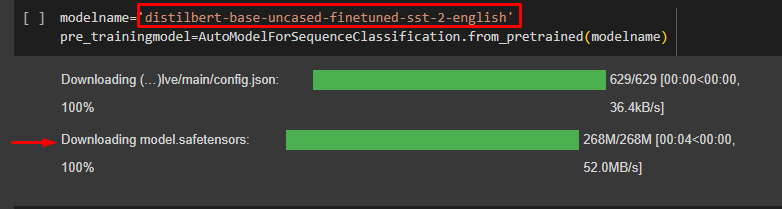

3. samm: importige mudel

' AutoModelForSequenceClassification ” on meetod, mis kuulub automaatklassi tokeniseerimiseks. The from_pretrained() meetodit kasutatakse mudeli tüübi põhjal õige mudeliklassi tagastamiseks.

Siin oleme esitanud mudeli nime ' mudeli nimi ” muutuja:

mudeli nimi = 'distilbert-base-uncased-finetuned-sst-2-english'eelkoolituse mudel =AutoModelForSequenceClassification.from_pretrained ( mudeli nimi )

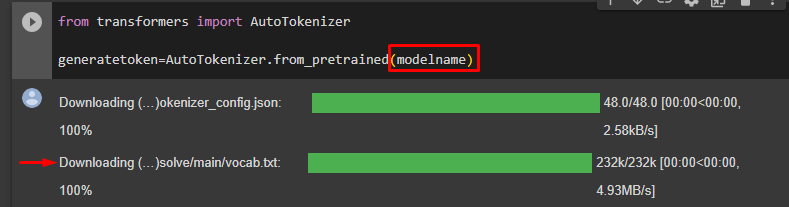

Step 4: Import AutoTokenizer

Esitage järgmine käsk žetoonide genereerimiseks, edastades ' mudeli nimi ' argumendina:

loodud märk =AutoTokenizer.from_pretrained ( mudeli nimi )

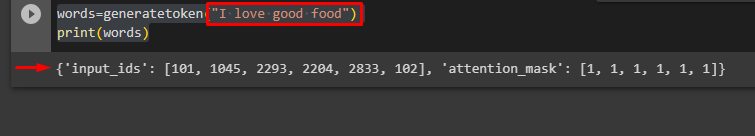

5. toiming: looge märk

Nüüd genereerime lausele märgid “Ma armastan head toitu” kasutades ' loodud märk ” muutuja:

printida ( sõnad )

Väljund antakse järgmiselt:

Kood ülaltoodule Google Co on siin antud.

Järeldus

Tokenisaatorite kasutamiseks Hugging Face'is installige teek, kasutades käsku pip, treenige mudelit AutoTokeniseri abil ja sisestage seejärel sisend tokeniseerimiseks. Tokeniseerimise abil määrake sõnadele kaal, mille alusel need järjestatakse, et säilitada lause tähendus. See skoor määrab ka nende analüüsiväärtuse. See artikkel on üksikasjalik juhend tokenisaatorite kasutamise kohta Hugging Face Transformersis.